调研易翻译,先明确目标用户与主要使用场景(学习、旅行、商务、日常会话等),然后做市场容量与竞品功能对比,接着用定性访谈把用户需求说清楚,再用定量问卷验证比例与优先级,最后通过原型测试、可用性评估与真实数据评测把产品打磨到可上线状态并持续跟踪效果与优化迭代。

一、为什么要做调研?先把问题说清楚

嗯,很多团队一听“调研”就头疼,其实它很像做饭前先买菜:你得知道要做什么菜(产品定位)、有多少人吃(市场大小)、喜欢什么口味(用户需求)、厨房能不能做(技术可行性)。如果这一步省了,后面做出来的可能就像放错调料的菜——再好也没人吃。

调研的核心目标(用一句话说清)

- 验证产品假设:易翻译的核心功能、定价、目标人群是否真实成立。

- 优先级排序:哪些功能先做、哪些可以后做、哪些不做。

- 可行性与风险识别:技术、数据、合规与成本问题在哪里。

- 可量化指标:确定上线要达到的关键指标(KPI)。

二、总体流程(一步步来,像做菜谱那样)

把调研分成四个阶段:准备 → 发现 → 验证 → 实证。每个阶段都有产出,不能混着做。

- 准备(1-2周):定义问题与指标,组建团队,列出研究方法和时间表。

- 发现(2-4周):做竞品地图、行业报告、专家访谈、深度用户访谈(定性)。

- 验证(2-4周):量化问卷、可用性测试、小范围AB实验。

- 实证(4-8周):原型上线试运营、收集真实使用数据并评估。

时间和资源(粗略估算)

小团队(3-5人)做MVP级调研大约需要8-12周;如果要做大样本、跨国对比,时间和预算要翻倍。别忘了标注:招募、激励、数据清洗、注释的成本。

三、具体怎么做:方法与工具一览(手把手)

下面我把每一步拆得细一点,像讲给初学者听:先是什么、为啥要做、怎么做、输出什么。

1. 明确用户与场景(Persona + 场景矩阵)

- 是什么:把用户按职业、语言能力、使用频率分组(学生、出差白领、旅行者、外教学习者等)。

- 为啥要做:不同用户关注点不同——学生更注重词汇解释和例句;商务用户更关注准确性与术语管理。

- 怎么做:内部讨论+小范围访谈(每类3-5人),收集典型任务和痛点。

- 输出:Persona卡片与场景矩阵(场景×需求优先级)。

2. 竞品与市场分析(不要只看功能,要看商业模式)

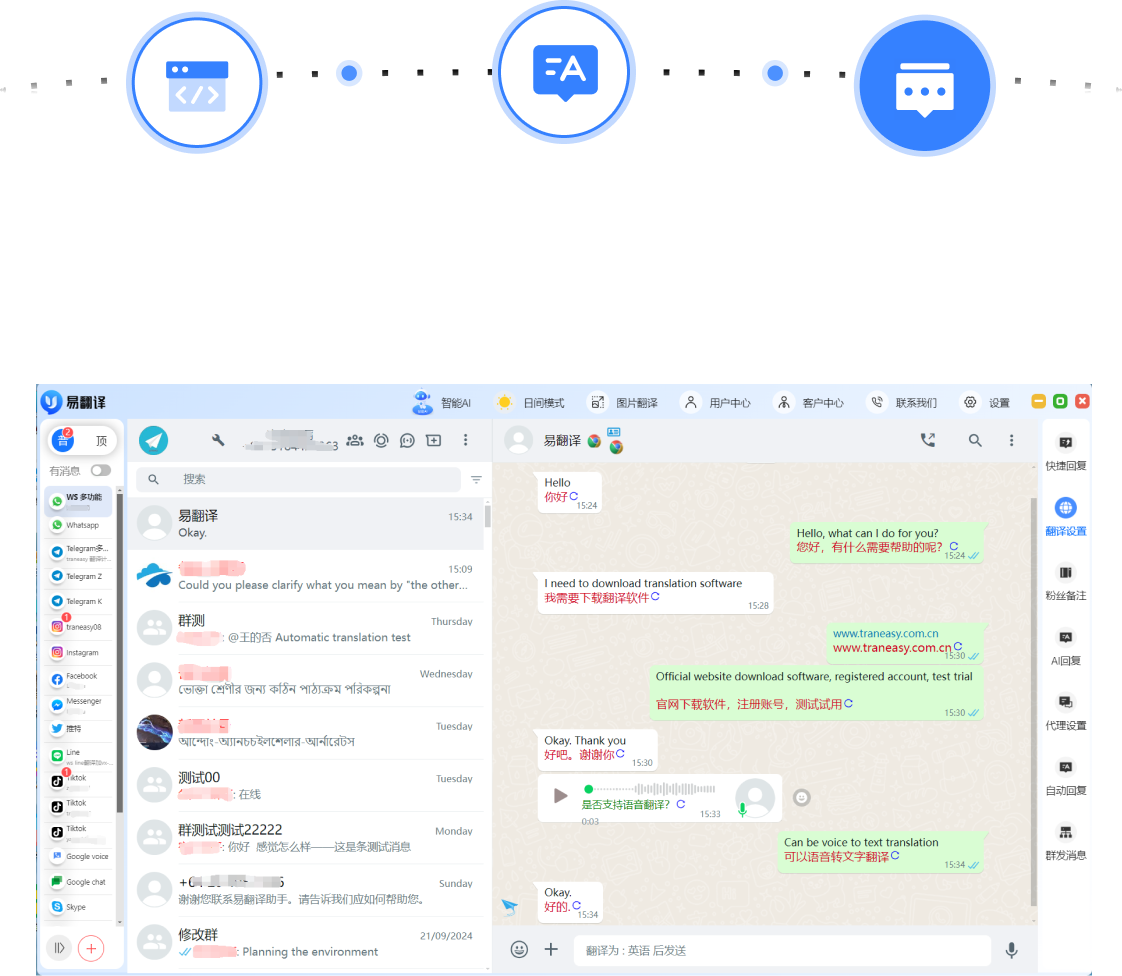

竞品不只是Google翻译、DeepL、以及国内的XX翻译,还包括具备跨语言沟通能力的硬件(翻译器)、社交类即时翻译工具等。

- 做法:列出功能表(文本翻译、语音互译、拍照取词、双语对话)、性能指标(延迟、准确率)、定价、平台覆盖、离线能力、隐私政策。

- 产出:竞品矩阵、优劣势分析和差异化机会。

3. 定性访谈(把用户的“为什么”问清楚)

定性访谈是灵魂活儿——你能听到故事和情绪,这能指导产品方向。

- 样本:每个Persona至少5-8人。

- 时长:30-60分钟/次,半结构化访谈。

- 关键问题示例:我一般怎么用翻译工具?最头疼的场景是什么?用过哪些替代品?付费意愿如何?

- 输出:问题卡片、痛点清单与语料摘录(可直接用于后续NLP评估)。

4. 量化问卷(验证频率与比例)

定性给你方向,定量告诉你“多少人这样想”。

- 样本规模:目标1000+问卷(产品早期至少300+)。

- 问卷重点:使用场景、使用频率、最常用功能、可接受延迟、付费意愿、满意度打分。

- 统计分析:分群、交叉分析(比如出差频率与付费意愿的关联)。

5. 原型与可用性测试(低成本快速验证)

做高保真原型或Wizard-of-Oz实验,把核心体验给用户试试。

- 目标:验证关键交互(语音识别的回显、翻译结果字体大小、对话切换逻辑)。

- 方法:任务驱动测试,记录任务成功率、平均完成时间、主观满意度(SUS)。

- 产出:可用性问题清单与改进建议。

6. 技术评估与数据实验

技术层面需评估模型精度、延迟、带宽和离线能力,还要测试数据需求。

- 指标举例:BLEU/ChrF(文本)、WER(语音)、Latency(ms)、错误类型分布(术语、长句、口语缩略)。

- 做法:准备代表性测试集(覆盖100+种常见句型、术语表和噪音录音),运行模型对比。

- 产出:性能报告(包含真实示例)、数据缺口与标注需求估算。

四、标注与数据管道(这块容易被低估)

如果翻译模型是“厨师”,数据就是“食材”。食材不好,做再多花样都救不了味道。

- 数据收集:从问卷、访谈、真实对话日志收集语料;注意脱敏与用户同意。

- 标注流程:制定标注指南(术语一致性、拆句规则、口语标注规范),做试标注并计算一致率(Kappa)。

- 质量控制:双重标注+仲裁,关键样本专家复核。

- 成本与速度:估算每千条标注成本,优先标注高频错误类型。

五、合规、隐私与商业化考量

别把合规当成最后一分钟的事。像处理用户语音、地点、联系人信息,这些都可能触及个人信息保护。

- 合规点:数据收集同意、最小化原则、本地化存储、用户可删除数据的流程(参照《个人信息保护法》)。

- 商业化:免费+增值(离线包、行业术语库、API接入)是常见策略,竞品的定价策略要梳理。

- 风险与缓解:模型偏见、翻译错误导致商业损失(案例保险/免责声明)。

六、如何评估“好不好”——核心指标样板

这些指标要在调研期就定义清楚,方便Later对比。

| 指标 | 解释 | 期望阈值(示例) |

| 任务成功率 | 用户完成预定翻译任务的比例(可用性测试中) | ≥90% |

| 响应延迟 | 从用户输入到显示翻译的时间(语音与文本分别统计) | 文本<200ms,语音<700ms |

| 准确性 | BLEU/WER/人工评分(关键术语准确率) | 行业对话场景BLEU提升≥10%或人工评分≥4/5 |

| 留存率 | 7天/30天留存 | 7天留存≥25% |

七、样例访谈与问卷题目(可直接拿去用)

实操来点模板,你就能立刻去招人、去跑调研。

访谈提纲(半结构化)

- 请描述上一次你最需要翻译工具但没用得好的经历?(场景、感受、后果)

- 你通常用什么工具?最喜欢/最不喜欢的点各是什么?

- 遇到翻译不准确时你会怎么办?会付费买吗?

- 对于语音互译,你接受的误差和延迟大概是多少?

问卷题目样例

- 你使用翻译工具的主要目的是什么?(多选)

- 你每天/每周使用多少次?

- 你最希望提升的功能(顺序打分):准确率 / 实时性 / 离线 / 专业术语 / 易用性

- 你愿意为以下哪项付费?(订阅/按次/企业授权)

八、落地建议与风险清单(别到最后才发现)

最后把所有可执行的建议和风险列出来,方便项目推进时有人盯着。

- 立即可做(短期):做3类Persona的深入访谈,发布300+问卷,做基本竞品矩阵,准备代表性测试集。

- 中期行动(MVP):实现核心功能原型(文本+语音互译+拍照),做可用性测试并修复Top10问题,上线A/B小流量。

- 长期计划:建立标注流水线、术语库、企业版功能与离线包,考虑国际化扩展。

- 主要风险:数据合规问题、标注一致性差、语音识别在嘈杂环境下失效、竞品技术更新速度快。

九、一份简单的里程碑表(供参考)

| 阶段 | 主要产出 | 时间 |

| 准备 | 目标、指标、时间表、招募计划 | 1-2周 |

| 发现 | Persona、竞品矩阵、深度访谈报告 | 2-4周 |

| 验证 | 问卷结果、可用性测试报告、技术评估 | 2-4周 |

| 实证 | MVP试运营数据、性能报告、上线建议 | 4-8周 |

写到这里我忽然想到一件小事:一定别低估“场景收集”的工作,很多翻译失败并不是模型不够强,而是场景没覆盖(例如方言、口音、行业术语、拍照畸变)。所以调研里那点“收场景、做样本”的活儿,真值得花时间。好,事情说到这儿,接下来就是动手去做了—一步一步来,别心急。