易翻译识别法语“联诵”(liaison)主要靠语音识别里的两个套路:一是在声学与语言模型里学会把连接音当作合法的发音变体来接收,二是在发音词典(或端到端模型的内部映射)里把有/无连接音的读法都映射回正确的书写形式。工程上要做的是收集带联诵的语料、把可选读法写进发音词典或做数据增强、用上下文语言模型去判别并用后处理把口语形式正写出来。用户侧则可通过选择法语、放慢语速、提供完整短语来提高识别率。(下面慢慢细讲,像在白板上一步步拆来讲清楚)

先把概念讲清楚:什么是法语“联诵”

联诵(法语 liaison)是指两个词相邻时,通常不发音的词尾辅音被连读到下一个以元音开头的词上,形成一个新的音连接。它既有固定规则,也有灵活用法:有些场合必须连读,有些场合禁止连读,还有些场合可选。联诵在口语里很常见,但书写中往往看不到,所以语音识别需要把“听到的声音”映射回“正确的文字”。

简单例子(听起来很直观)

- les amis 发音像 [le z ami],书写是 les amis(s 发成 /z/)。

- un ami 发音像 [y n ami],书写是 un ami(n 变成辅音连接)。

- grand homme 发音像 [gʁɑ̃ t ɔm],书写是 grand homme(t 被读出)。

把识别问题拆成小块:从听到声音到输出文字的流程

要认识到一个语音翻译应用里,法语联诵的“识别”不是单一模块能解决的,它横跨好几个环节:

- 声学特征提取:把麦克风信号转成频谱、梅尔倒谱等,用来判别哪个音出现了。

- 声学模型(ASR):把帧级特征映射到音素或文字单位。现代系统是深度神经网络或Transformer,能学习把连读形式当成一种变体。

- 发音词典 / G2P:把单词到音素的映射写清楚,尤其要包含有/无联诵的发音变体,便于把表面声音映射回正确单词。

- 语言模型(LM):利用上下文概率偏好那些在语法上合理的词序和形态,从而在模糊音的情况下选出更可能的书写结果。

- 后处理 / 正规化:把ASR输出(可能是音素或近似写法)映射成标准书写,包括处理省略、撇号、h 阻断等。

两种工程思路:显式建模与端到端学习

- 显式建模:构建发音词典,把常见联诵变体(如 s->/z/, t->/t/, n->/n/等连接)都列入候选发音,结合LM进行重评分和解码。优点是可控、易调;缺点是需要人工设计和大量发音条目。

- 端到端模型:用大量带标注的法语语音文本对训练Transformer/CTC/Attention模型,模型能在内部隐式学习到联诵现象并直接输出书写形式或子词。优点是简单管线、鲁棒;缺点是需要海量数据并且不易解释。

工程细节:系统如何“知道”要把连音写成哪个词

下面把关键技术点列清楚,按“听到音 -> 判别 -> 输出字”的顺序来解释。

1. 声学信号与特征

- 联诵通常在词边界处出现短时辅音能量或爆破(如 t, p, k, n 的辅音特征),以及连读后的声学过渡。声学模型通过频谱、梅尔滤波器组等捕捉这些细节。

- 语调、时长和音高(prosody)也提供线索:连读音往往持续短、与前后元音连贯。

2. 发音词典(Pronunciation Lexicon)与可选读法

实际工程里,把常见联诵写成多个发音变体是最直接的方法。例如:

| 书写 | 发音变体 |

| les amis | /le.zami/ 和 /le.ami/(无联诵的少见写法) |

| un ami | /ynami/ |

| grand homme | /gʁɑ̃tɔm/ |

解码器在匹配声学证据时,会把这些候选发音都考虑进来,然后借助语言模型选最优书写输出。

3. 语言模型的判别作用

- 在模糊情况下(例如背景噪声让 /z/ 和 /s/ 难以区分),LM 会用语序和词频来偏好更“合理”的组合(比如“les amis”比“le samis”更有可能)。

- 基于子词(BPE)或字符的LM对法语好,因为它能处理缺省的连写或撇号问题。

4. 后处理与规则校正

把ASR输出转成标准书写往往需要额外规则:处理脱落的撇号(l’ami)、拒绝非法联诵(遇到 h aspiré 的词不要连读)、把可选联诵按语境选择。很多系统用规则+统计结合的方式做这个步骤。

按类型说清楚:联诵的三类和识别难点

| 类型 | 举例 | 识别提示 |

| 必须性联诵(obligatoire) | les amis, nous avons | 训练数据多,ASR较容易学会并输出正确书写 |

| 可选联诵(facultative) | ils arrivent(正式说/连读取决语体) | 依赖上下文与风格判断,LM和语料风格匹配很重要 |

| 禁止联诵(interdite) | 单数名词后、多数以 h aspiré 开头的词 | 错误连读会导致错误插入辅音,需后处理屏蔽 |

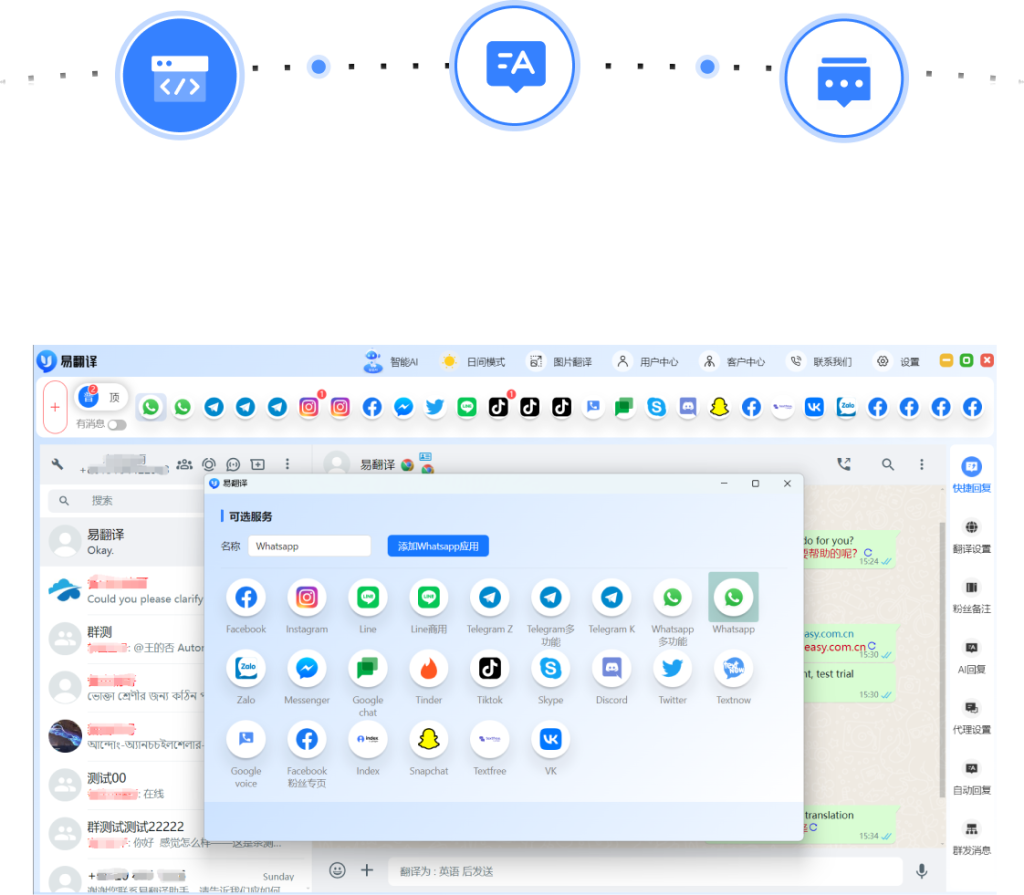

对用户有用的操作建议(让易翻译更准确识别法语联诵)

- 开口前选对语言:确保把识别语言切到“法语”,避免语言识别混淆。

- 说完整句子:联诵依赖上下文,提供完整短语能让LM更好判断。

- 适当放慢语速:尤其在含有敏感边界(如 /s/ 或 /t/)的短语,放慢可以让系统更清楚地捕捉连接音。

- 避免强背景噪声:噪声会掩盖短促的连音,影响判断。

- 如出现误识别,手动纠正:多数翻译工具会记住常见纠正,长期使用会逐步提升准确率。

- 在必要时把单词稍微分开发音:非母语者若不确定是否要连读,轻微停顿能帮助文本回写更接近书写形式。

常见问题和应对举例(真实场景很实用)

- 场景:背景嘈杂时“les amis”被识别成“le samis”。应对:重说或在句中补全上下文(例如“Ce sont les amis de Pierre”),LM 会更稳。

- 场景:可选联诵导致系统写法不一(有时输出带连音、有时不带)。应对:在设置里选择“正式/书面语”风格(若可选),或手动统一文本。

- 场景:遇到 h aspiré 的词,系统误连。应对:校正并反馈,或插入短停顿帮助识别。

开发者小抄:如果你要在模型里实现联诵识别

- 数据:收集包含多种语体(新闻、对话、广播)的法语语音,并标注/保留联诵现象。

- 词典:把常见联诵变体写成候选发音并为它们赋予概率。

- 训练:在声学模型训练里做数据增强(加噪、变速)以提高模型对连音的鲁棒性;端到端模型可直接学习,但需大量数据。

- LM 与后处理:用强上下文LM来解决歧义,用规则识别 h aspiré 和禁止联诵的情形。

- 评测:在真实对话集上按字级错误率(WER)和词级错误率评估,特别标注联诵相关错误率。

好像讲了挺多,但要记住两件事:第一,联诵本质上是“声音到书写”的歧义——系统要学会接受不同发音还原到同一个单词;第二,用户能做的很简单:把法语设对、说清楚、给出上下文。工程上用词典变体、数据增强和强LM基本能把大多数联诵问题解决掉。说到这里,有点像在修一台老收音机:把每个接头都检查一遍,直到声音和文字吻合得顺眼——过程可能不完美,但慢慢能让工具越用越懂你。